Zer da Robots.txt fitxategia? SEOrako robot fitxategi bat idazteko, bidaltzeko eta berriro arakatzeko behar duzun guztia

Artikulu zabal bat idatzi dugu bilatzaileek zure webguneak nola aurkitzen, arakatu eta indexatzen dituzten. Prozesu horretan oinarrizko urratsa da robots.txt fitxategia, bilatzaile baten atea zure webgunea arakatzeko. Robots.txt fitxategi bat behar bezala nola eraiki ulertzea ezinbestekoa da bilatzaileen optimizazioan (SEO).

Tresna sinple baina indartsu honek web-arduradunei bilatzaileak beren webguneekin nola elkarreragiten duten kontrolatzen laguntzen die. Robots.txt fitxategi bat ulertzea eta modu eraginkorrean erabiltzea ezinbestekoa da webgunearen indexazio eraginkorra eta bilatzaileen emaitzetan ikusgarritasun optimoa bermatzeko.

Zer da Robots.txt fitxategia?

Robots.txt fitxategia webgune baten erro-direktorioan dagoen testu-fitxategi bat da. Bere helburu nagusia da bilatzaileen arakatzaileak gidatzea gunearen zein zati arakatu eta indexatu behar diren edo ez. Fitxategiak Robots Exclusion Protokoloa erabiltzen du (REP), web arakatzaile eta beste web robot batzuekin komunikatzeko erabiltzen duten webgune estandarra.

REP ez da Interneteko estandar ofiziala, baina bilatzaile nagusiek oso onartua eta onartzen dute. Onartutako estandarretik hurbilen dagoena Google, Bing eta Yandex bezalako bilatzaile nagusien dokumentazioa da. Informazio gehiagorako, bisitatu Google-ren Robots.txt zehaztapenak gomendatzen da.

Zergatik da Robots.txt kritikoa SEOrentzat?

- Arakatze kontrolatua: Robots.txt-ek webgunearen jabeei aukera ematen die bilatzaileei beren guneko atal zehatzetara sartzea eragotziko diete. Hau bereziki erabilgarria da eduki bikoiztuak, eremu pribatuak edo informazio sentikorra duten atalak baztertzeko.

- Arakatze-aurrekontu optimizatua: Bilatzaileek webgune bakoitzeko arakatze-aurrekontu bat esleitzen dute, bilatzaileen bot batek gune batean arakatuko duen orrialde kopurua. Garrantzirik gabeko atalak edo hain garrantzitsuak ez diren atalak baztertuz, robots.txt-ek arakatze-aurrekontu hau optimizatzen laguntzen du, orrialde esanguratsuagoak arakatu eta indexatzen direla bermatuz.

- Webgunea kargatzeko denbora hobetua: Bot-ek garrantzirik gabeko baliabideak atzitzea eragotziz, robots.txt-ek zerbitzariaren karga murriztu dezake, gunearen karga-denbora hobetuz, SEOren faktore kritikoa.

- Publikoak ez diren orrialdeak indexatzea saihestea: Publikoak ez diren eremuak (eszenaratzeko guneak edo garapen-eremuak adibidez) indexatu eta bilaketa-emaitzetan ager ez daitezen laguntzen du.

Robots.txt funtsezko komandoak eta haien erabilerak

- Baimendu: Zuzentarau hau arakatzaileek guneko zein orrialde edo atal sartu behar duten zehazteko erabiltzen da. Esate baterako, webgune batek SEOrako bereziki garrantzitsua den atal bat badu, 'Baimendu' komandoak arakatu dela ziurtatu dezake.

Allow: /public/- Baztertu: "Baimendu"-ren kontrakoa, komando honek bilatzaileen botei webgunearen zenbait zati ez arakatzeko agintzen die. Hau erabilgarria da SEO baliorik ez duten orrietarako, hala nola saioa hasteko orriak edo script fitxategiak.

Disallow: /private/- Komodinak: Komodinak ereduak parekatzeko erabiltzen dira. Izartxoak (*) edozein karaktere-sekuentzia adierazten du, eta dolarraren zeinuak ($) URL baten amaiera adierazten du. Hauek URL sorta zabala zehazteko erabilgarriak dira.

Disallow: /*.pdf$- Gune mapak: Robots.txt-en gune-mapen kokapen bat sartzeak bilatzaileei laguntzen die gune bateko orrialde garrantzitsu guztiak aurkitzen eta arakatzen. Hau funtsezkoa da SEOrentzat, gune baten indexazio azkarrago eta osatuagoa egiten laguntzen baitu.

Sitemap: https://martech.zone/sitemap_index.xmlRobots.txt Komando gehigarriak eta haien erabilerak

- Erabiltzaile-agentea: Zehaztu zein arakatzaileri aplikatzen zaion araua. 'Erabiltzaile-agentea: *' araua arakatzaile guztiei aplikatzen die. Adibidea:

User-agent: Googlebot- Noindex: Robots.txt protokolo estandarraren parte ez den arren, bilatzaile batzuek ulertzen dute a Noindex robots.txt-en zuzentaraua zehaztutako URLa ez indexatzeko instrukzio gisa.

Noindex: /non-public-page/- Arakatze-atzerapena: Komando honek arakatzaileei eskatzen die denbora jakin bat itxaron behar dutela zure zerbitzariari atzituen artean, erabilgarria zerbitzariaren karga-arazoak dituzten guneetarako.

Crawl-delay: 10Nola probatu zure Robots.txt fitxategia

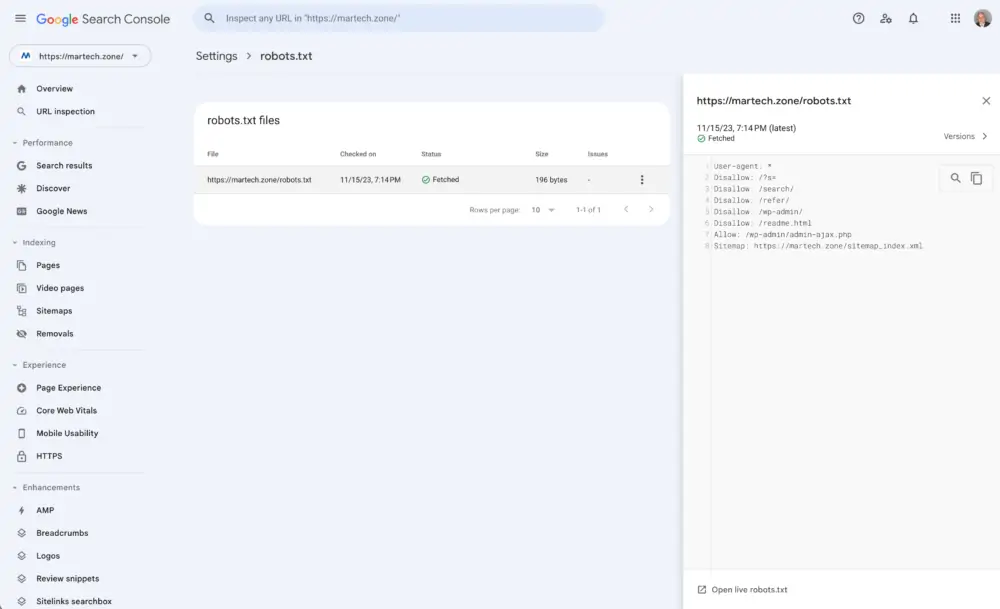

Bertan lurperatuta egon arren Google Webmaster, bilaketa-kontsolak robots.txt fitxategi-probatzailea eskaintzen du.

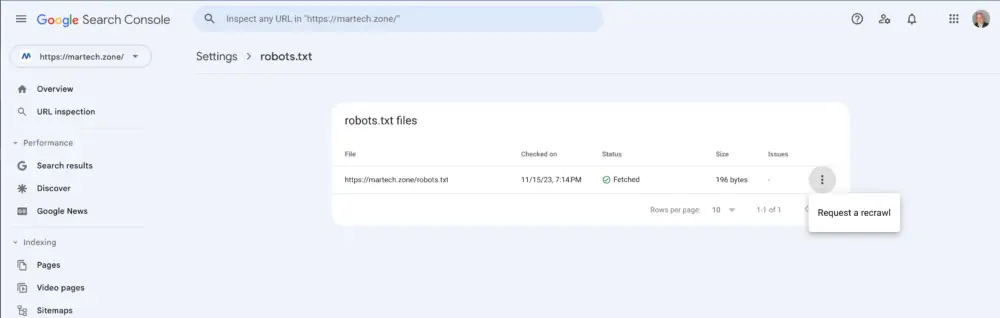

Zure Robots.txt fitxategia berriro bidal dezakezu eskuineko hiru puntuetan klik eginez eta hautatuta Eskatu berriro arakatzea.

Probatu edo bidali berriro zure Robots.txt fitxategia

Robots.txt fitxategia AI Bots kontrolatzeko erabil al daiteke?

Robots.txt fitxategia ala ez definitzeko erabil daiteke AI bot-ek, web arakatzaileak eta beste robot automatizatu batzuk barne, zure webguneko edukia arakatu edo erabil dezakete. Fitxategiak bot hauek gidatzen ditu, webgunearen zein zati atzitzeko baimena duten edo debekatuta dauden adieraziz. AI bot-en portaera kontrolatzeko robots.txt-en eraginkortasuna hainbat faktoreren araberakoa da:

- Protokoloa betetzea: Bilatzaile ospetsuenek eta beste AI bot askok ezarritako arauak errespetatzen dituzte

robots.txt. Hala ere, garrantzitsua da kontutan izan fitxategia eskaera bat dela murrizketa betegarria baino. Bot-ek eskaera horiei jaramonik egin diezaiekete, bereziki eskrupulu gutxiagoko entitateek operatutakoak. - Argibideen berezitasuna: Bot desberdinetarako argibide desberdinak zehaztu ditzakezu. Esate baterako, baliteke AI bot espezifikoei zure webgunea arakatzea baimentzea, beste batzuk baimentzen ez dituzten bitartean. Hau erabiliz egiten da

User-agentzuzentarauarobots.txtgoiko fitxategiaren adibidea. Adibidez,User-agent: GooglebotGoogle-ren arakatzailerako argibideak zehaztuko lituzke, berrizUser-agent: *bot guztietan aplikatuko litzateke. - Mugak: Bitartean

robots.txtbot-ek zehaztutako edukia arakatzea eragotzi dezakete; ez die edukia ezkutatzen dagoeneko badakite URL. Gainera, ez du inolako baliabiderik ematen edukiaren erabilera murrizteko, behin arakatu ondoren. Edukiaren babesa edo erabilera-murriztapen zehatzak behar badira, pasahitz babesa edo sarbide-kontrolerako mekanismo sofistikatuagoak bezalako beste metodo batzuk beharrezkoak izan daitezke. - Bot motak: AI bot guztiak ez daude bilaketa-motorrekin lotuta. Hainbat bot erabiltzen dira helburu ezberdinetarako (adibidez, datuen agregazioa, analitika, edukien scraping). Robots.txt fitxategia bot mota desberdin hauentzako sarbidea kudeatzeko ere erabil daiteke, betiere REP-ari atxikita.

The robots.txt fitxategia tresna eraginkorra izan daiteke AI botek guneko edukia arakatzeari eta erabiltzeari buruzko zure lehentasunak adierazteko. Hala ere, bere gaitasunak sarbide-kontrol zorrotza ezartzera mugatzen dira jarraibideak ematera, eta bere eraginkortasuna robotek Roboten Bazterketa Protokoloa betetzen dutenaren araberakoa da.

Robots.txt fitxategia SEO arsenaleko tresna txiki baina indartsua da. Webgune baten ikusgarritasunean eta bilatzaileen errendimenduan nabarmen eragin dezake behar bezala erabiltzen denean. Gune baten zein zati arakatzen eta indexatzen diren kontrolatuz, web-arduradunek beren edukirik baliotsuena nabarmentzen dela ziurtatu dezakete, SEO ahaleginak eta webgunearen errendimendua hobetuz.